Від діпфейку до дисциплінарної скарги: юристи про ризики штучного інтелекту в адвокатурі

Штучний інтелект уже є в залах засідань — у промтах адвокатів, документах прокуратури і навіть у боті для моніторингу СІЗО. На круглому столі НААУ говорили, як не відстати від машини і не наразитися через неї на дисциплінарну скаргу.

Батіг, але для нас

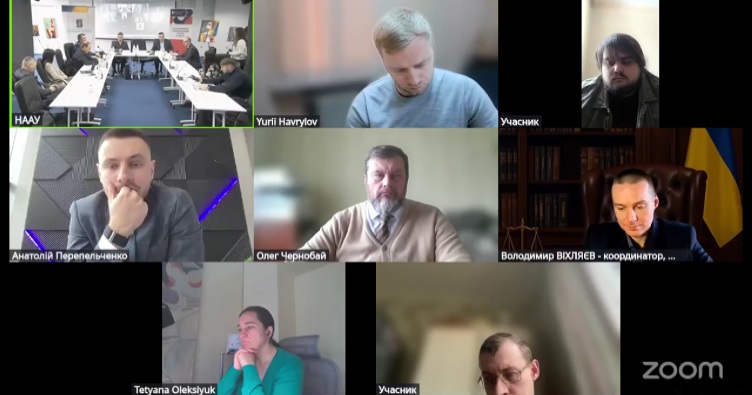

У Національній асоціації адвокатів України відбувся круглий стіл, присвячений використанню штучного інтелекту в адвокатській діяльності. Захід організували спільно комітет НААУ з питань законотворчої діяльності, комітет НААУ з питань цифровізації адвокатури та профільна робоча група в партнерстві з Фундацією Пилипа Орлика.

Тон дискусії задав заступник голови НААУ Валентин Гвоздій: ШІ є таким самим інструментом, як колись ручка чи друкарська машинка. Проте «батігмає два кінці» — і негативний бік уже проявляється на практиці. За спостереженнями спікера, документи НАБУ останнім часом готуються явно за допомогою ШІ — і готуються якісно. «Ми не повинні, як адвокати, відставати від правоохоронних органів, від прокуратури, від судів. Ми теж повинні використовувати ці інструменти», — наголосив В.Гвоздій.

Водночас головним застереженням стало те, що «найгірше, що може зробити адвокат, — це просто перекласти свою роботу на машину». Наочним прикладом послужила реальна ситуація: в судовому рішенні з’явилась підказка системи — «хочеш, я запропоную більш зрозумілу редакцію цього абзацу». Суддя не дочитав і не видалив. Тепер на нього подана дисциплінарна скарга.

Директор Фундації Пилипа Орлика Артем Миколайчук поставив питання ширше: ШІ вже не просто інструмент. Посилаючись на Юваля Харарі та його виступ у Давосі, спікер зазначив, що технологія набула суб’єктності. Паралельно він навів дані аналітиків: рівень безробіття у США може сягнути 10,2% до кінця 2027 року, а ІТ-компанії в Індії подекуди скоротили персонал до 80%. «Якщо зараз не продумаємо правильну модель взаємодії штучного інтелекту з людиною, ми ризикуємо опинитися в майбутньому, яке не зможемо контролювати», — попередив він.

Голова комітету НААУ з питань цифровізації адвокатури Андрій Приходько підтвердив: комітет уже розглядав скарги, де ШІ використовувався для створення вебсайтів та рекламних матеріалів — швидко і продуктивно, але з конкретними порушеннями закону про адвокатуру та Правил адвокатської етики. «Я повинен взяти на себе обов’язок і створити навчальний матеріал для адвокатів, де ми скажемо, що можна використовувати і покажемо, як не можна», — повідомив А.Приходько.

Шість проблем одного промту

Член комітету з питань цифровізації НААУ Анатолій Перепельченко структурував дискусію, виокремивши 6 ключових проблем використання ШІ в адвокатській діяльності.

Перша — адвокатська таємниця і конфіденційність. Більшість сервісів зберігають і аналізують усі введені запити, в тому числі фабули справ і персональні дані клієнтів. «Юристи або адвокати, які вводять клієнтські дані без чіткої політики або методичних рекомендацій, ризикують порушити адвокатську таємницю та принцип нерозголошення», — пояснив він.

Друга — «галюцинації»: система може генерувати цілком фіктивні судові рішення, постанови і цитати законів, яких не існує.

Третя — ШІ не здатен приймати етичні рішення, оцінювати репутаційні ризики і прогнозувати поведінку суду.

Четверта — відповідальність: незалежно від того, хто готував документ, підпис і відповідальність залишаються за адвокатом.

П'ята — зміна очікувань клієнтів, що веде до знецінення адвокатської праці.

Шоста — відсутність галузевих стандартів щодо того, що і як можна вводити в системи ШІ.

А.Перепельченко також розповів про явище «AIDR» («AI Didn't Read») — інтернет-мем, яким користувачі позначають низькоякісний ШІ-контент і застерігають від його використання. «Це символ зростаючої недовіри до бездумно згенерованого АІ-контенту», — зауважив спікер.

Найбільш наочним прикладом практичного застосування ШІ стала демонстрація начальника відділу Запорізької облпрокуратури, к.ю.н. Юрія Гаврилова. Він представив власний AI-чат-бот для моніторингу місць несвободи — систему на основі ChatGPT з жорсткою архітектурою інструкцій і нормативною базою даних. Завантажуєш фото місця несвободи — і за секунди отримуєш аналіз за критеріями умов тримання, посилання на норми національного законодавства, практику ЄСПЛ і конкретні рекомендації. «Те, що раніше займало десятки хвилин, зараз займає десятки секунд», — зазначив Ю.Гаврилов. Бот також перевіряє законність адміністративних затримань.

А.Приходько продовжив тему практичних ризиків реальним кейсом: до його адвокатського бюро звернулись із Грузії. Клієнт скаржився на шахрайство і скинув відео, де керуючий партнер бюро грузинською мовою консультував і давав реквізити для оплати. Жодного стосунку до реальності це відео не мало. «Ми розуміємо, що це пряма шахрайська схема з використанням діпфейку. Поки ми думаємо, як це регулювати, ті, хто швидкі, вже реалізували це на практиці», — підкреслив адвокат.

Регламент — не опція

Член робочої групи НААУ, представник моніторингового органу Ради Європи Тетяна Олексіюк сфокусувалась на питанні довіри до ШІ в судочинстві. Нейромережі, за її словами, залишаються «чорною скринею». До того ж системи навчаються на контенті, що сам є результатом роботи ШІ. «AI учиться сам у себе і продає нам за чисту монету», — попередила Т.Олексіюк. Вона нагадала про рамкову конвенцію Ради Європи про штучний інтелект та права людини, демократію та верховенство права, а також Конвенцію 108 щодо захисту персональних даних при автоматизованій обробці. Завантаження персональних даних у великомовні моделі — це їх поширення необмеженому колу осіб.

Ширший регуляторний підхід запропонував голова робочої групи НААУ Олег Чернобай: «Ви намагаєтесь аналоговим правом регулювати цифровий світ». Аналогове законодавство може лише «накладати латки» на окремі проблеми — натомість потрібно формувати цифрове право, цифрову юрисдикцію і цифрові кодекси. Метою для України О.Чернобай визначив «електронну юрисдикцію для електронних екосистем».

А.Перепельченко, підсумовуючи, закликав написати методичні рекомендації, які стали б частиною Правил адвокатської етики щодо використання ШІ. «Забороняти точно не треба, потрібно створювати і очолювати етичні стандарти», — запевнив він.

Завершуючи круглий стіл, модератор наголосив: учасникам необхідно об’єднати зусилля для аналізу проблемних питань і вироблення законодавчих пропозицій, щоб «мінімізувати ризики використання систем штучного інтелекту, і щоб дійсно вони були на користь адвокатам, на користь клієнтам, а не на шкоду».

Дискусія правників про штучний інтелект тривала майже 4 години.

Матеріали за темою

Коментарі

До статті поки що не залишили жодного коментаря. Напишіть свій — і будьте першим!